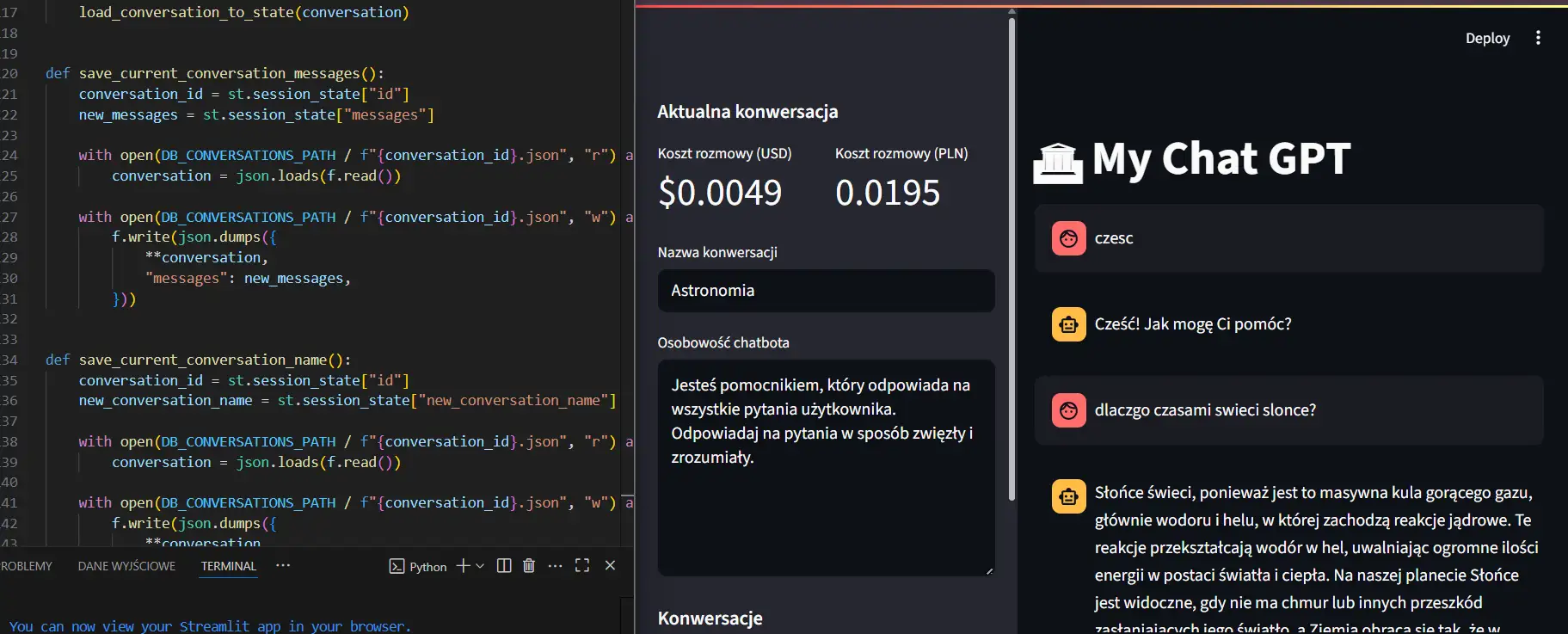

My Chat GPT – własny interfejs ChatGPT z kontrolą kosztów

Korzystanie z modeli językowych przez gotowe interfejsy często ukrywa rzeczywisty koszt generowania odpowiedzi. Użytkownik widzi rozmowę, ale nie widzi, ile faktycznie kosztuje każda sesja i jakie mechanizmy stoją za działaniem modelu.

W tym projekcie stworzyłem własny interfejs ChatGPT, który umożliwia prowadzenie rozmów z modelami OpenAI z jednoczesną, pełną kontrolą nad zużyciem tokenów i kosztami API. Aplikacja ma charakter demonstracyjny i edukacyjny.

Co robi aplikacja?

- umożliwia prowadzenie rozmowy z modelami językowymi OpenAI,

- zlicza tokeny wejściowe (input) i wyjściowe (output),

- przelicza zużycie tokenów na realny koszt korzystania z API,

- pokazuje koszt każdej sesji rozmowy w sposób czytelny dla użytkownika.

Dlaczego to ma sens biznesowy?

- uświadamia, jak szybko mogą rosnąć koszty przy niekontrolowanym użyciu LLM,

- pokazuje różnicę między interfejsem a rzeczywistym kosztem modelu,

- jest punktem wyjścia do budowy własnych narzędzi AI opartych o API,

- pomaga projektować rozwiązania AI z myślą o skalowalności kosztów.

Technologia

- Python – logika aplikacji,

- Streamlit – interfejs webowy,

- OpenAI API – komunikacja z modelami językowymi.

To przykład, jak AI w praktyce może być wykorzystywane świadomie — z naciskiem na kontrolę kosztów, a nie tylko efekt końcowy rozmowy.

Zobacz inne realizacje